最新一代继续在成本效益、速度和性能方面突破极限。Mistral Large 2在la Plateforme平台上发布,新增了许多功能,方便构建创新的AI应用。

Mistral Large 2

Mistral Large 2拥有128k的上下文窗口,支持包括法语、德语、西班牙语、意大利语、葡萄牙语、阿拉伯语、印地语、俄语、中文、日语和韩语在内的多种语言,还支持超过80种编程语言,包括Python、Java、C、C++、JavaScript和Bash。

Mistral Large 2专为单节点推理和长上下文应用设计,具备1230亿参数,能够在单节点上实现大吞吐量。Mistral Large 2在Mistral Research License下发布,允许研究和非商业用途的使用和修改。商业用途需获取Mistral Commercial License,通过联系我们获取。

综合性能

Mistral Large 2在性能和成本方面设立了新的标准。特别是在MMLU评估中,预训练版本达到了84.0%的准确率,刷新了开源模型在性能/成本比上的记录。

代码和推理能力

借鉴Codestral 22B和Codestral Mamba的经验,Mistral Large 2在大量代码数据上进行训练,表现远超之前的Mistral Large,并且与领先的模型如GPT-4o、Claude 3 Opus和Llama 3 405B表现相当。

详细基准测试

大量精力也用于提升模型的推理能力,重点减少模型“幻觉”生成错误信息的倾向,通过细致的调整使模型在回应时更加谨慎和可靠。此外,Mistral Large 2能够在无法找到解决方案或没有足够信息时,主动承认这一点。这种对准确性的承诺在数学基准测试中表现得尤为明显,展示了其增强的推理和解决问题的能力。

指令执行和对齐

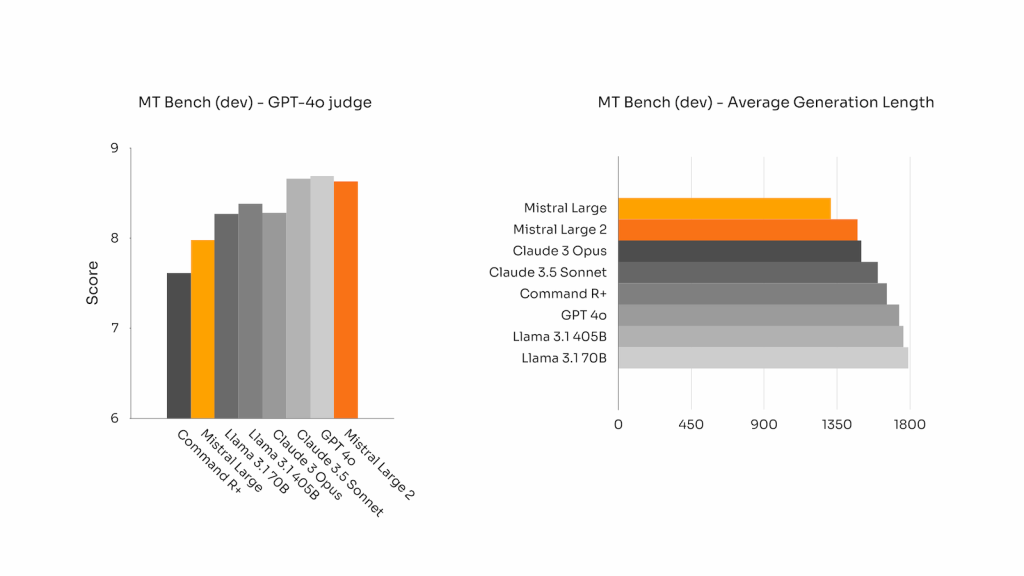

Mistral Large 2的大幅改进在于其指令执行和对话能力,尤其在精确指令的遵循和长对话处理上表现优异。下图展示了MT-Bench、Wild Bench和Arena Hard基准测试中的表现:

语言多样性

如今,许多商业用例涉及多语言文档处理。虽然大多数模型以英语为主,新版Mistral Large 2在多语言数据上进行了大量训练,特别擅长处理英语、法语、德语、西班牙语、意大利语、葡萄牙语、荷兰语、俄语、中文、日语、韩语、阿拉伯语和印地语。下图展示了Mistral Large 2在多语言MMLU基准测试中的表现,与之前的Mistral Large、Llama 3.1模型和Cohere’s Command R+进行了对比。

工具使用和函数调用

Mistral Large 2具备增强的函数调用和检索技能,经过训练可以高效执行并行和顺序函数调用,使其成为复杂业务应用的强大引擎。

试用Mistral Large 2

今天起,用户可以在la Plateforme平台上使用名称为mistral-large-2407的Mistral Large 2,并在le Chat上测试 (https://console.mistral.ai/)。它在24.07版本(我们对所有模型采用的YY.MM版本系统)下可用,API名称为mistral-large-2407。指令模型的权重也可在HuggingFace上获取。(https://huggingface.co/mistralai/Mistral-Large-Instruct-2407)

在la Plateforme平台上整合了两种通用模型:Mistral Nemo和Mistral Large,以及两种专业模型:Codestral和Embed。随着旧模型逐步淘汰,所有Apache模型(如Mistral 7B、Mixtral 8x7B和8x22B、Codestral Mamba、Mathstral)仍可通过mistral-inference和mistral-finetune SDK进行部署和微调。从今天起,la Plateforme平台上将扩展微调能力,现在可用于Mistral Large、Mistral Nemo和Codestral模型。