过去一年,人工智能领域取得了令人瞩目的进展。如今,备受期待的 Gemini 2.0 系列首款模型正式发布,这就是实验版本的 Gemini 2.0 Flash。作为技术的前沿之作,这款模型以低延迟和卓越性能成为核心主力。

此外,借助 Gemini 2.0 的原生多模态能力,一系列研究原型也同步亮相,展示了代理研究的新边界。

Gemini 2.0 Flash:速度与实力并存

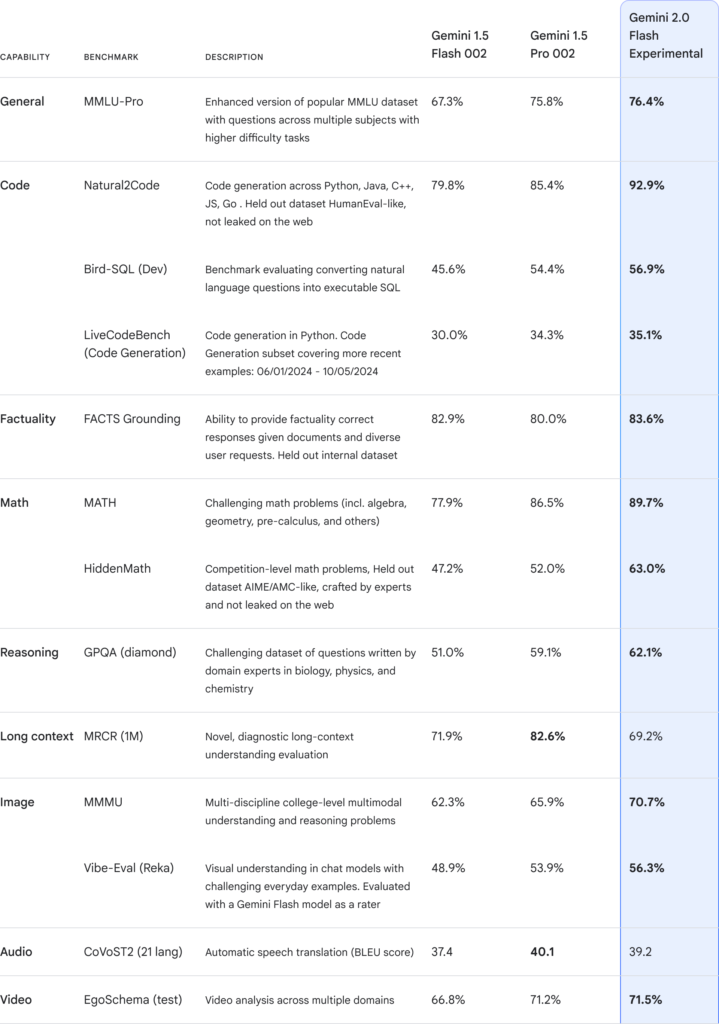

Gemini 2.0 Flash 是对大受欢迎的 1.5 Flash 的全面升级,其性能在保持极快响应速度的同时大幅提升。更惊人的是,它在关键基准测试中不仅超越了 1.5 Pro,速度还提升了一倍。

这一版本还加入了多项新功能,支持多模态输入如图像、视频和音频的同时,还能生成多模态输出,包括原生生成的图文混合内容和可调整的多语种语音合成(TTS)。更强大的是,它还能原生调用工具,如 Google 搜索、代码执行,以及第三方用户定义功能。

为开发者准备的详细对比图清楚展示了 Gemini 各版本的能力。公司目标是以安全且高效的方式将模型交到用户手中。过去一个月里,开发者已经接触到了早期实验版本的 Gemini 2.0,并给予了非常积极的反馈。

目前,Gemini 2.0 Flash 作为实验模型通过 Gemini API 向开发者开放,可以在 Google AI Studio 和 Vertex AI 中使用,支持多模态输入和文本输出。而 TTS 和原生图像生成功能,则优先向早期合作伙伴提供。明年一月,更多模型尺寸版本将全面上线。

为帮助开发者构建动态、互动式应用,还推出了全新 Multimodal Live API,支持实时音频和视频流输入,并可结合多个工具使用。更多关于 Gemini 2.0 Flash 和 Multimodal Live API 的详细信息已发布在开发者博客中。

Gemini 2.0 登陆 Gemini 应用

从今天起,全球用户可在桌面和移动网页版 Gemini 中,通过模型下拉菜单选择 Gemini 2.0 Flash 的优化聊天版本。不久之后,移动应用版本也将支持这一功能。这一升级版将带来更强大的 AI 助手体验。

明年初,Gemini 2.0 将进一步扩展到更多 Google 产品中。

用 Gemini 2.0 解锁 AI 代理体验

得益于 Gemini 2.0 Flash 的原生用户界面操作能力,以及多模态推理、长上下文理解、复杂指令执行与规划、函数调用组合、原生工具使用和优化延迟等多项改进,全新一代 AI 代理体验应运而生。

AI 代理的实际应用是一个充满可能性的研究领域。公司正在探索这一前沿技术,包括一系列能协助人们完成任务的研究原型。这些原型包括 Project Astra 的更新版,一个探索未来通用 AI 助手功能的研究项目;全新 Project Mariner,重点研究人机交互的未来,起步于浏览器;以及 Jules,一个帮助开发者的 AI 驱动代码代理。

虽然目前仍处于开发早期阶段,但公司对可信测试者的反馈充满期待,这些反馈将为未来更广泛的产品化提供宝贵的经验。